Toda vez que você pergunta algo ao Claude sobre o seu projeto, ele relê os arquivos do zero — e você paga por cada token. O Graphify resolve isso transformando seu codebase em um grafo de conhecimento persistente, consultável e incrivelmente eficiente.

71.5× Redução de tokens por query.

Em testes com corpora mistos (código + papers + diagramas), o custo médio caiu de ~123k tokens por consulta para apenas ~1,7k.

O problema: você paga para o LLM “se orientar”

Pense num projeto médio: 50 arquivos, documentação em PDF, algumas gravações de reuniões de arquitetura. Você pergunta “como funciona o fluxo de autenticação?” — e o assistente de IA lê tudo novamente, do zero, a cada query. Em projetos grandes, isso significa centenas de milhares de tokens queimados só para o modelo descobrir onde as coisas estão.

Cada token que o Claude gasta se “orientando” é um token que ele não está gastando resolvendo o seu problema.

“Graphify faz a análise cara uma única vez, comprime tudo num grafo de conhecimento consultável — e esse grafo fica em disco para sempre.”

Como o Graphify funciona por dentro

A beleza da arquitetura do Graphify está em ser honesta sobre o que sai da sua máquina. O processo é dividido em três passes distintos:

1. Extração AST determinística 🔒 código nunca sai da máquina

O tree-sitter analisa seu código-fonte usando gramáticas formais. Classes, funções, imports, call graphs, docstrings — tudo extraído sem nenhum LLM, sem chamada de rede. Suporta 25 linguagens. Cada aresta recebe a tag EXTRACTED: fato verificável, custo zero além de CPU.

2. Transcrição local de áudio ⚡ local

O faster-whisper transcreve seus vídeos e arquivos de áudio localmente. Gravações de reuniões, walkthroughs de arquitetura, screencasts de design — viram nós de texto no grafo sem nunca sair do seu hardware.

3. Extração semântica ☁ conteúdo semântico enviado

PDFs, docs e imagens passam pelo LLM configurado no seu assistente — mas apenas o conteúdo semântico, nunca o código-fonte raw. Atenção: documentos confidenciais chegam ao seu provedor de IA.

O resultado? Um grafo com nós, arestas e comunidades — armazenado em disco, reutilizado em todas as sessões futuras.

Instalação e primeiros passos

# Instalar via pip pip install graphify-codebase # Gerar o grafo do seu projeto graphify build --path ./meu-projeto # Ver o relatório gerado cat graphify-out/GRAPH_REPORT.md # Consultar parte específica do codebase graphify query "mostre o fluxo de autenticação" --graph graphify-out/graph.json # Limitar saída a um orçamento de tokens graphify query "como funciona o billing?" --budget 2000

O que você recebe como saída

Após rodar o graphify build, a pasta graphify-out/ contém:

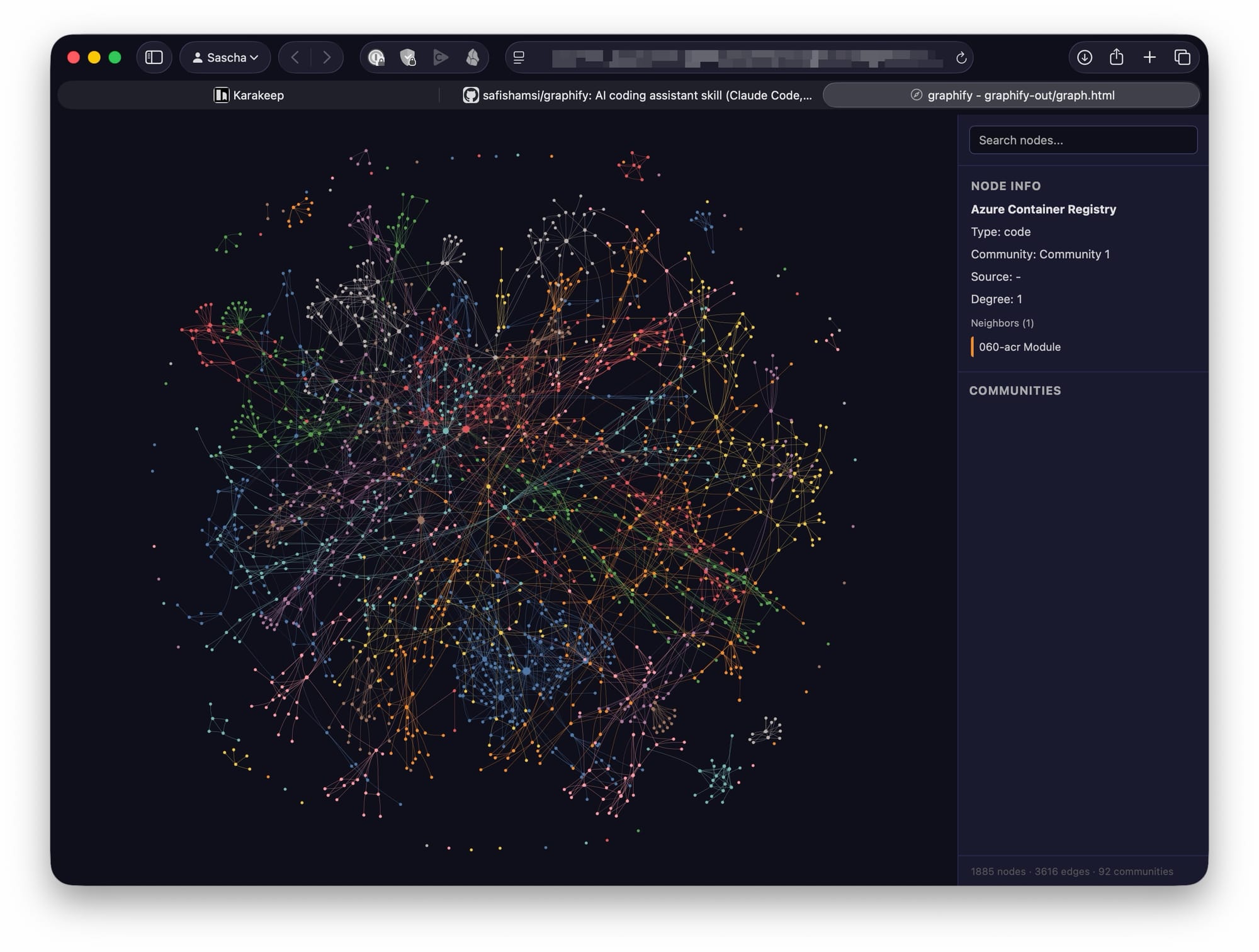

graph.html

Interativo

Visualize relações no browser

GRAPH_REPORT.md

Sumário

Insights + god nodes detectados

graph.json

Persistente

Grafo consultável via CLI ou MCP

cache/

Incremental

Só reprocessa arquivos alterados

Exemplo real: biblioteca HTTP em Python

Para 6 arquivos Python modelando uma camada de transporte HTTP, o Graphify gerou:

| Métrica | Resultado | Insight |

|---|---|---|

| Nós no grafo | 144 | Classes, funções, imports mapeados |

| Arestas | 330 | Relações entre componentes |

| Comunidades detectadas | 6 | Algoritmo Leiden (agrupamento temático) |

| “God nodes” detectados | Client, AsyncClient, Response, Request | Nós de alta centralidade |

| Aresta surpresa | DigestAuth → Response | Relação implícita revelada |

Exemplo real: 52 arquivos mistos (repos + papers)

3 repositórios de frameworks GPT + 5 papers sobre atenção + 4 diagramas (~92k palavras):

| Abordagem | Tokens por query | Resultado |

|---|---|---|

| Naive (ler arquivos brutos) | ~123.000 tokens | Frequentemente bate context limit |

| Graphify | ~1.700 tokens | 71.5× mais eficiente |

Integração com MCP e Claude Code

O Graphify expõe o grafo do codebase como ferramentas chamáveis por LLM via MCP server — tornando-se um bloco fundamental para agentes autônomos que precisam de compreensão estruturada do código, não apenas busca por arquivos.

.claude/settings.json

{

"mcpServers": {

"graphify": {

"command": "graphify",

"args": ["mcp", "--graph", "./graphify-out/graph.json"]

}

}

}

Com isso, em vez de varrer arquivos aleatoriamente, o Claude navega usando o grafo. Não é sobre prompts melhores ou modelos maiores — é sobre construir uma camada de memória.

A lógica por trás: por que grafos vencem

A ideia não é nova: Andrej Karpathy demonstrou que você não precisa de um banco de vetores sofisticado para reduzir tokens. Você precisa de arquivos markdown bem organizados com links explícitos — o LLM lê índices e segue links ao invés de busca por similaridade.

O Graphify aplica essa lógica ao código. O grafo torna as relações explícitas e consultáveis antes do Claude tocar no contexto da sua sessão.

“Um usuário pegou 383 arquivos espalhados + 100 transcrições de reuniões e derrubou o uso de tokens em 95% ao consultar com Claude.”

Vale a pena? Considerações honestas

O número de 71.5× é auto-reportado e merece escrutínio. A lógica é sólida — subgrafos pequenos e relevantes são estruturalmente mais eficientes do que arquivos brutos completos. O cache incremental torna execuções subsequentes baratas, mas a primeira indexação de um repositório grande pode ser custosa.

Para projetos pequenos (menos de 20 arquivos), o overhead provavelmente não compensa. Para codebases médias e grandes com documentação mista — PDFs de arquitetura, gravações, múltiplos módulos — o Graphify é uma das intervenções mais práticas disponíveis hoje para reduzir o custo operacional de assistentes de IA.

O Graphify não faz nada misterioso. Ele resolve um problema simples: o Claude não deveria re-ler coisas que poderiam ser pré-computadas. Para codebases grandes, elimina a maior parte do custo de “orientação”. Essa é a história toda — e é suficiente.

Acesse em: graphify.net →